共计 29632 个字符,预计需要花费 75 分钟才能阅读完成。

1. 项目定位与整体执行链路

1.1 它到底是什么

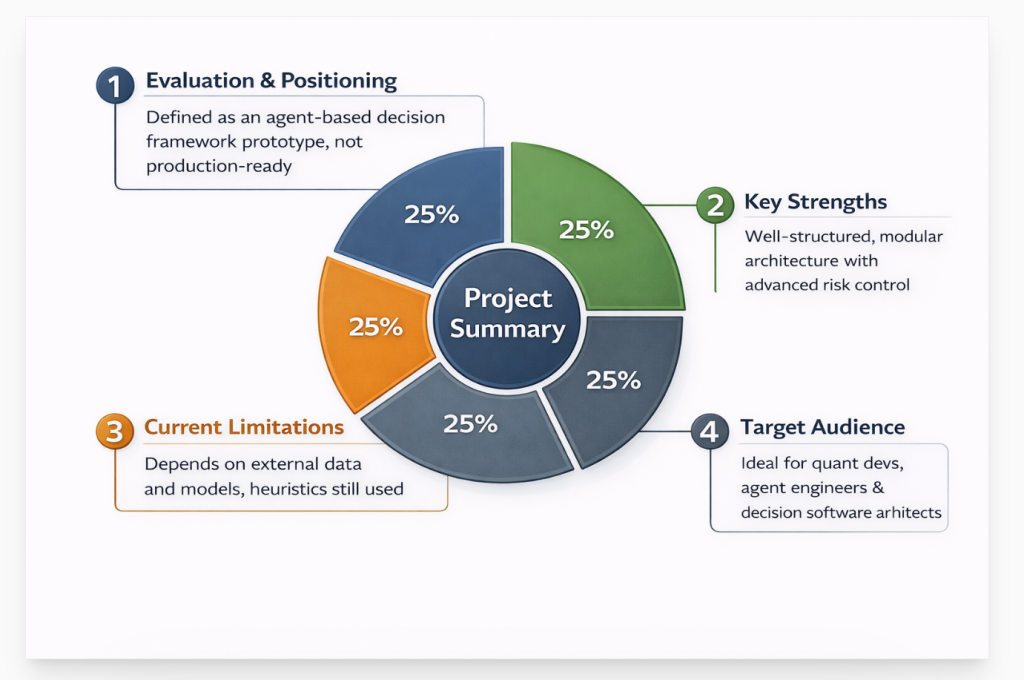

virattt/ai-hedge-fund 很容易因为名字被误解。第一次看到这个仓库的人,通常会以为它的核心卖点是“让一群 AI 替你炒股”。但如果真的沿着源码走下来,会发现它更像一个 Agent 化投研与执行框架。它的重点并不是让大模型直接预测涨跌,而是把交易决策拆成分析、风控、组合管理和回测几个层次,再通过一条可重复执行的工作流把这些层次串起来。

从工程视角看,这种设计比“单个大模型输出买卖建议”成熟得多。因为投资系统真正复杂的地方,从来不只是方向判断,而是如何组织多种分析视角、如何限制风险敞口、如何把连续的仓位约束转成离散的可执行动作,以及如何用回测沿时间轴验证整条链路。这个仓库之所以值得写技术博客,正是因为它试图把这些部分一起装进一个统一框架里。

1.2 整体执行链路怎么走

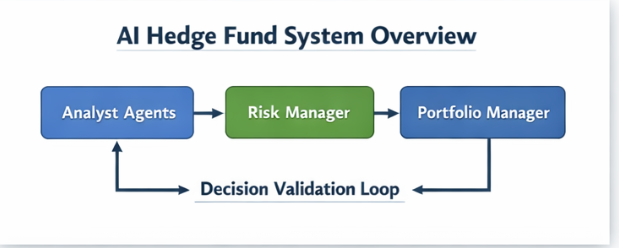

把整个仓库的决策链路压缩一下,大致可以表示成一条非常清楚的流水线:用户从 CLI 或 Web 发起一次请求,src/main.py 用 LangGraph 创建工作流,多个 analyst agent 先写出不同类型的分析信号,随后 risk_management_agent 根据价格、波动率和相关性算出仓位边界,再由 portfolio_management_agent 把这些边界裁成合法动作集合,最后才让 LLM 在这个动作集合里做最终选择。

这个顺序不是随意排列的,而是系统设计上的核心。因为它明确规定了 LLM 在整个流程里的位置:不负责产生原始市场数据,不负责直接决定风险边界,也不负责理解交易系统所有约束,而是被放在一个已经经过分析、风控和动作裁剪之后的有限决策空间中。 这恰恰是该项目最有参考价值的地方。

1.3 为什么这种分层重要

很多 AI Agent 项目会犯一个典型错误:一上来就把所有上下文和所有任务都塞给一个“超级 Agent”。这样做的代价通常是提示词越来越长、行为越来越难控制、输出越来越难验证。ai-hedge-fund 没有走这条路。它做了明确分层:分析层负责提供视角,风控层负责计算边界,执行层负责在边界内做选择,回测层负责沿时间轴复现整个过程。

这种分层的直接收益是可解释性和可维护性。你可以单独替换分析代理,可以单独改进风控规则,也可以在不改动上游模块的前提下更换最终决策模型。对于任何复杂的 Agent 系统来说,这种“先拆角色,再拆边界,最后再决定模型放在哪里”的工程思路,比单纯追求提示词技巧更重要。

1.4 这篇文章会怎么讲

为了把这个仓库讲清楚,后面的内容会围绕 10 个主章节展开:先讲如何运行,再讲入口与状态对象,然后拆分析层、风控层和执行层,继续补上核心源代码解读,最后用项目总结收束全文。和普通项目介绍不同,这篇文章会把重点放在几个真正决定系统质量的函数上,尤其是 risk_manager.py、portfolio_manager.py 和 BacktestEngine。

原因很简单。这个仓库里最值得学的,不是“某个投资大师 agent 的提示词怎么写”,而是 如何把风控约束转成机器可执行的动作空间,再让 LLM 只处理最后一步高价值选择。只要抓住这条主线,整套源码的层次就会非常清楚。

1.5 先给出一个阅读结论

如果你是第一次接触这个仓库,我建议先带着一个判断去看它:它不是一个“AI 量化成品”,而是一个“多代理投研工作流原型”。这意味着你不应该用“它能不能直接赚钱”去评价它,而应该用“它有没有把复杂业务流程组织成可执行代码”去评价它。

从这个标准看,virattt/ai-hedge-fund 的确做到了几件很像样的事:它有统一状态对象,有配置化的 analyst 注册,有分层的工作流,有独立风控节点,有组合管理节点,还有回测入口和 Web 界面。也正是因为这些部分都在,才值得把它当成一篇硬核技术博客来拆。

2. 如何运行:CLI、回测和 Web 三种入口

2.1 环境准备

如果想真正理解一个仓库,最好的起点通常不是先读代码,而是先把它跑起来。ai-hedge-fund 的基础安装非常直接:克隆仓库、复制 .env.example、安装 Poetry 依赖,然后准备金融数据 API key 和至少一个 LLM provider 的 key。官方依赖说明里已经把 OpenAI、Anthropic、DeepSeek、Groq、Google 以及本地 Ollama 等接入方式都列出来了,所以你并不被绑定在单一模型提供商上。

这一点在实际使用中非常重要。因为这个仓库的运行边界并不只是“本地 Python 代码”,而是“本地业务逻辑 + 外部金融数据 + 外部模型推理”的组合。如果后面你要把它做成长期研究环境,缓存、失败重试、provider 降级、成本控制都会成为真实问题。安装阶段虽然看起来简单,但它已经把这些工程现实暴露出来了。

2.2 CLI 单次决策怎么用

最直接的入口是 src/main.py。你可以用一条非常简单的命令去触发一次完整的分析—风控—组合管理流程,比如对 AAPL,MSFT,NVDA 跑一轮决策。也可以通过参数指定起止时间窗口,让整个系统围绕某个历史截面或观察区间做判断。

CLI 模式最适合两类场景。第一类是你正在读 src/agents/* 的源码,希望快速验证某个 agent 改动之后会不会影响最后输出。第二类是你只想调试核心决策链路,而不想同时启动前后端。对于研究代码来说,这种轻量入口通常比 Web 界面更有效率,因为你可以更直接地看到日志、错误和结构化输出。

2.3 回测入口怎么用

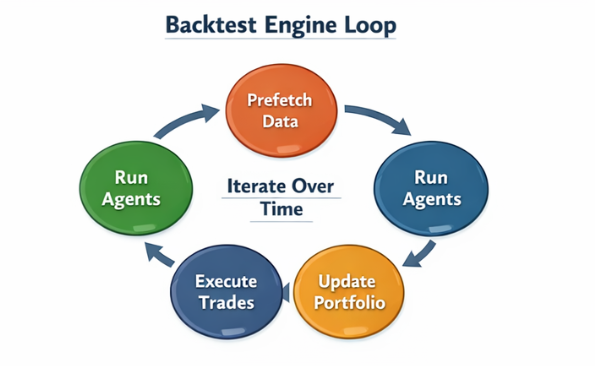

仓库把回测单独放在 src/backtester.py 里,而不是让你在 main.py 里加一个参数切换。这个设计本身就值得肯定,因为它把“单次决策”和“时间序列回放”分成了两条职责不同的路径。你仍然使用相同的 analyst、risk manager 和 portfolio manager,但整个系统不再只跑一次,而是沿着交易日逐步推进。

对读代码的人来说,这一点很关键。因为它说明这个项目不是仅仅为了做一次“好看”的推理演示,而是真的在尝试回答:如果把这套决策流水线按时间顺序反复调用,历史表现会怎样?一旦进入回测层,很多原本在单次运行里不明显的问题,比如缓存、数据预取、重复调用成本、结果持久化,都会变得非常真实。

2.4 Web 方式怎么用

如果你更关心交互体验,仓库还提供了 app/ 目录下的一整套 Web 应用。官方推荐的一键脚本是 run.sh 或 run.bat,开发者模式则是分别启动 app/backend 的 FastAPI 和 app/frontend 的 React/Vite。默认情况下,前端跑在 5173 端口,后端 API 跑在 8000,同时还会暴露 Swagger 文档页。

Web 模式和 CLI 的差别,不只是“多了个页面”。更重要的是,它迫使你从产品化角度理解这个仓库:用户如何选择 analyst、如何填写 ticker、如何选择模型、如何触发运行、如何查看结果。很多只看命令行代码的人,会忽略掉这一层。而实际上,一个 Agent 工作流能不能变成可交付的工具,往往取决于它能不能自然地被前后端包装起来。

2.5 运行方式该怎么选

如果你的目标是读源码,我建议优先用 CLI。因为它最轻量,最少干扰,也最适合单步验证。只要你主要修改的是 src/main.py、src/agents/*、src/backtesting/* 这些文件,CLI 就足够了。如果你的目标是看交互流程、检查后端接口,或者你准备把这套东西演示给别人,那就再启动 Web。

换句话说,这个仓库之所以适合做技术博客,不只是因为它“概念有趣”,而是因为它天然提供了三种不同粒度的观察窗口:CLI 看最小闭环,回测看时间轴,Web 看产品外壳。三者组合在一起,能让你更完整地理解整个系统。

3. 入口与状态

[src/main.py、src/graph/state.py、src/utils/analysts.py]

3.1 为什么要先读这三个文件

如果把这个仓库比作一台机器,那么 src/main.py、src/graph/state.py 和 src/utils/analysts.py 就分别对应“装配线入口”“内部总线”和“部件目录”。不先看这三个文件,直接去读单个 agent,很容易只看到局部逻辑,却不知道它在整台机器里处在什么位置。

这三个文件的最大价值,不在算法,而在组织方式。它们回答的是:整个系统如何初始化,多个代理如何共享上下文,代理节点又是如何被统一注册和调度的。理解了这三件事,后面所有源码都会变得顺畅很多。

3.2 run_hedge_fund():一次完整运行的入口

src/main.py 里最先该看的函数是 run_hedge_fund()。这个函数本身没有做复杂金融计算,它做的是 orchestration:初始化 portfolio、调用 create_workflow() 创建 LangGraph、编译图、传入统一状态,然后从 final_state 中拿出决策结果和 analyst 输出。

这个设计的好处是职责非常清楚。单次运行要做的所有事情都通过同一份状态对象进入图中,而不是在不同函数之间传一长串参数。这样后续无论你是从 CLI、后端 API 还是回测引擎发起调用,系统内部都能沿着相同的状态结构执行。

3.3 create_workflow():图比链更适合这里

如果说这个仓库有一个最能体现架构思路的函数,那就是 create_workflow()。它用 StateGraph(AgentState) 把 analyst 节点、risk_management_agent、portfolio_manager 串成一张有向图,而不是简单地做顺序函数调用。所有 analyst 都从同一个 start_node 发散出去,随后统一收敛到风险节点,再进入组合管理节点,最后结束。

这个设计表面上只是“用了 LangGraph”,但真正重要的是它背后的建模方式:作者没有把问题当成一条长 prompt,而是当成一张工作流图。分析是并列视角,风控是统一收敛层,组合管理是最终执行层。对于复杂业务系统,这比线性链式调用更自然,也更利于扩展。

3.4 AgentState:多代理系统最关键的基础设施

src/graph/state.py 里的 AgentState 定义虽然很短,却是整个系统最不能忽视的部分。它把状态明确拆成 messages、data 和 metadata 三块,并通过不同聚合方式让节点之间共享这些内容。消息轨迹用追加方式聚合,业务数据和运行配置则通过 merge 的方式聚合。

这意味着整个系统始终围绕一份显式状态对象工作。谁往里写入 analyst_signals,谁读取 portfolio,谁追加 messages,都发生在一个统一容器里。这种写法会极大降低多代理系统的混乱程度,因为你不需要再靠隐式变量和散乱函数参数去猜测上下文流向。

3.5 show_agent_reasoning() 的意义

同一文件中的 show_agent_reasoning() 不是业务核心,但它对调试极其有价值。多代理系统最常见的调试痛点不是“程序报错”,而是“结果不合理却不知道是哪一层出的问题”。当某只股票被最终判成 buy 或 short 时,你真正想看到的是:哪个 analyst 给了 bullish,哪个给了 bearish,risk manager 是怎么限制仓位的,portfolio manager 最后又看到了什么动作空间。

从这个角度说,reasoning 展示能力其实也是 Agent 系统的一部分。没有这层可观察性,系统就会退化成一个黑箱。而 ai-hedge-fund 至少在这一点上已经具备了比较好的工程意识。

3.6 ANALYST_CONFIG:代理注册表的价值

src/utils/analysts.py 的关键在于 ANALYST_CONFIG。它把 analyst 的 display_name、description、investing_style、agent_func、type、order 等信息集中管理,再由 get_analyst_nodes() 统一导出成图节点配置。这种“注册表 + 导出函数”的模式,在规模稍微大一点的 Agent 系统里几乎是必需的。

原因很现实。只要 agent 一多,如果没有统一注册表,就会开始出现前端一套名字、CLI 一套名字、后端又一套映射,最后维护成本极高。而这里的做法让 CLI、API 和前端都可以共享同一份 agent 元数据,这是非常实用的工程设计。

3.7 入口层的真正价值

所以,这一层源码最重要的不是某个具体函数有多复杂,而是它告诉我们:复杂 Agent 系统首先要解决的是装配问题,而不是推理问题。 只有把状态、节点和注册表整理好,后面讨论风控、执行和回测才有意义。

这也是我建议所有读者都先从 main.py、state.py 和 analysts.py 开始的原因。你先看懂了这三个文件,后面每个 agent 才不是孤立的脚本,而是整条工作流上的一个明确节点。

4. 分析层源码

[fundamentals.py、sentiment.py、technicals.py]

4.1 分析层到底负责什么

很多人第一次看这个项目,会把注意力放在“哪个投资大师 agent 最酷”。但从工程上说,分析层真正负责的事情只有一件:把各类外部数据转成结构化信号,写入 analyst_signals。 它既不是最终下单层,也不是风控层,更不是回测层。它的职责应该尽量纯粹。

也正因为如此,判断分析层写得好不好,不是看 prompt 多华丽,而是看它有没有做到三件事:尽量基于结构化数据、尽量减少不必要的模型臆测、尽量把输出写成统一格式。ai-hedge-fund 在这方面做得比许多“AI 金融项目”更克制。

4.2 fundamentals_analyst_agent():最像规则引擎的 agent

fundamentals.py 是最适合先读的分析模块,因为它几乎完全体现了“规则优先”的思路。这个 agent 会通过 get_financial_metrics() 拉财务指标,然后围绕四个维度做判断:盈利能力、成长性、财务健康和估值。每个维度都由具体指标和明确阈值组成,例如 ROE、净利率、营业利润率、营收增长、EPS 增长、流动比率、负债权益比、P/E、P/B、P/S 等。

这类实现方式有一个很大的优点:它不让 LLM 去想象一家公司的基本面,而是先用程序把财务指标变成明确的 bullish / bearish / neutral 结论,再把这个结论结构化写出来。即使你不认同具体阈值,也很难否认这种写法比“把财报文本扔给模型让它猜”更稳健。

4.3 为什么基本面模块值得借鉴

fundamentals_analyst_agent() 最值得学习的地方,并不是它的指标选得有多高级,而是它示范了一种正确的金融 Agent 范式:数据提取由 API 负责,判断尽量由确定性逻辑负责,reasoning 则由代码直接组织成结构化结果。换句话说,模型如果在这里出现,也只能扮演很后置的角色。

这种范式非常适合迁移。无论你以后做行业研究 agent、财务风控 agent,还是别的结构化专业任务,最可靠的方式通常都不是“全靠模型理解”,而是“先把该算的算完,再让模型只做后置总结”。

4.4 sentiment_analyst_agent():轻量融合而不是纯文本情绪

sentiment.py 采用的是另一种思路。它同时抓取内幕交易数据和公司新闻情绪,并给两者分配了不同权重:内幕交易 0.3,新闻情绪 0.7。最后通过加权方式得到整体情绪信号和置信度。这说明作者并没有把情绪分析简化为“调用一个 LLM 看新闻标题”,而是把行为数据和文本数据结合在了一起。

从工程角度看,这种轻量融合非常合理。内幕交易和新闻情绪的噪声结构不同、时间属性不同、可信度也不同。先把它们各自映射成统一信号,再做显式聚合,是一种比“直接交给模型总结”更容易控制和调试的实现方式。即便你以后想加更多信号源,这种框架也很容易继续扩展。

4.5 technical_analyst_agent():更接近 mini signal engine

technicals.py 是分析层里最接近传统量化特征工程的模块。它不会只算一个 RSI 或均线,而是把技术面分析拆成五类子策略:趋势跟随、均值回归、动量、波动率和统计套利。每一类子策略都会对价格 DataFrame 做自己的处理,最后再通过 weighted_signal_combination() 融合成一个总信号。

这种写法的好处是模块化。你可以把它看成一个小型 signal ensemble:每个子策略都是独立插槽,有自己的 signal、confidence 和 metrics,最后统一输出结果。对于后续扩展非常友好,因为你想加新的策略,不需要推翻整个模块,只需要在统一接口下新增一个子策略并给出权重即可。

4.6 分析层最重要的共性

这三个分析模块虽然内容不同,但它们有一个共性:都在尽量把外部信息转成结构化、可解释、可聚合的中间结果。 这比直接让模型端到端输出结论要有价值得多,因为后面的风控层和执行层只关心信号,不关心原始文本或原始财务表格。

所以分析层真正提供给下游的,不是“意见”,而是一套经过压缩和标准化的中间数据。这也是为什么 portfolio_manager.py 后面可以只读取 {signal, confidence} 这样的简化结构,而不用重新面对全量上游上下文。

4.7 分析层该如何继续演进

如果你以后基于这个仓库做二次开发,分析层是最好扩展的一层。你可以换更严谨的基本面打分规则,可以把新闻情绪做得更细,可以把技术分析模块接成真正的因子引擎,甚至可以把某个 analyst 完全替换成 sklearn 或深度学习模型。只要输出格式保持一致,下游几乎都不用动。

这恰恰说明了当前分析层设计的成功之处:它不是死死绑定某一种分析方法,而是提供了一个适合持续插拔和演进的信号生产层。

5. 风控函数

[src/agents/risk_manager.py]

5.1 为什么风控层是这套系统的关键

如果只看 analyst agent,这个仓库会显得很像许多“AI 金融 demo”:一堆角色给观点,然后把观点拼起来。但真正让它从 demo 走向工程的是 risk_manager.py。因为只要没有风控层,系统就仍然停留在“谁更看多、谁更看空”的讨论;一旦加入风控层,它就开始回答更接近真实交易系统的问题:在当前组合状态下,这只股票最多还能开多大仓?

这也是我认为这个文件比绝大多数 analyst 文件都更值得精读的原因。它不是在讲故事,而是在做约束变换:把市场风险特征和组合风险特征换算成可执行的仓位边界。

5.2 risk_management_agent() 的整体职责

risk_management_agent(state, agent_id="risk_management_agent") 是风控层总入口。它从 state["data"] 中读取 portfolio、tickers、start_date、end_date,然后不仅会分析本轮要处理的 ticker,还会把当前已有持仓一起纳入计算。这样做是必要的,因为相关性约束和组合暴露计算不可能只看“这次想买什么”,还必须看“你已经持有什么”。

它的输出不是买卖建议,而是一个风控结果对象,写入 state["data"]["analyst_signals"][agent_id]。其中最关键的字段包括 remaining_position_limit、current_price、volatility_metrics、correlation_metrics 和 reasoning。这意味着风控层输出的是一个标准化中间产物,既能给程序下游继续用,也能给人类调试时查看。

5.3 risk_management_agent() 的第一段:抓价格、算波动率

这个函数的第一步,是构造 all_tickers = set(tickers) | set(portfolio.get("positions", {}).keys()),然后对每个 ticker 调 get_prices() 拉取区间价格,再通过 prices_to_df() 变成 DataFrame,并调用 calculate_volatility_metrics() 计算波动率。与此同时,它还会保留每个 ticker 的收益率序列,为后面的相关性矩阵做准备。

这个阶段最值得注意的,是它的边界处理非常保守。如果价格缺失或者样本不足,它不会假装一切正常,而是直接给出高风险默认值,比如更高的波动率和更差的百分位位置。这是非常典型的 fail-safe 风格:拿不到数据时不要默认安全,而要默认更危险。 对风控模块来说,这是一个很成熟的习惯。

5.4 calculate_volatility_metrics():基础风险度量函数

calculate_volatility_metrics(prices_df, lookback_days=60) 是这个模块里的基础函数。它的输入很简单,就是一个至少包含 close 列的价格表和一个观察窗口长度。输出则包括 daily_volatility、annualized_volatility、volatility_percentile 和 data_points。其中最值得注意的,不是年化波动率本身,而是它只用最近窗口的收益率去估当前风险,而不是整个历史区间。

这很合理,因为仓位边界更应该反映最近市场状态,而不是被很久以前的价格噪声稀释。同时它还会给出 volatility_percentile,也就是当前波动率在历史分布中的位置。这个字段虽然不会直接决定仓位,但会进入 reasoning,增强风控输出的可解释性。

5.5 risk_management_agent() 的第二段:相关性与组合总值

在拿到足够多的收益率序列之后,函数会尝试构造对齐后的 returns_df,再计算 correlation_matrix = returns_df.corr()。这里有两个保护条件:收益率数据必须足够、ticker 数量也要足够。否则就退化为“仅按波动率限制仓位”的模式,不硬做相关性分析。

随后,函数还会识别当前组合中真正有暴露的持仓,并计算组合总净值。后续所有仓位上限都不是凭空给一个绝对数字,而是按组合总值的某个百分比来控制。这一点非常重要,因为它让风险约束天然随组合规模变化,而不是写死在某个固定美元值上。

5.6 calculate_volatility_adjusted_limit():把波动率映射成仓位比例

这是风控模块里最直观的规则函数。calculate_volatility_adjusted_limit(annualized_volatility) 会根据年化波动率分段调整基础仓位上限。低波动股票可以允许更高权重,中高波动会逐步压缩,超高波动则被严格限制。你可以把它理解为一个非常实用的 heuristic risk budget 函数。

它最大的优点不是金融上绝对正确,而是工程上非常好替换。未来你完全可以把它换成 VaR 约束、行业分层规则、因子风险模型或者其他更复杂的仓位预算函数,而不需要改动整个风控节点结构。也就是说,这个函数的价值更多在于“接口和位置”,而不是当前参数一定最优。

5.7 calculate_correlation_multiplier() 与最终仓位边界

如果说波动率回答的是“这只股票本身危险不危险”,那 calculate_correlation_multiplier(avg_correlation) 回答的就是“它加进来以后会不会让整个组合更拥挤”。高相关时乘数小于 1,低相关时乘数略高于 1。这样一来,风控层最终会把“单票风险”和“组合拥挤度”两种信息合并进一个结果里。

最后,risk_management_agent() 会把这些比例换成美元级别的 position_limit,再扣掉当前已有暴露,得到 remaining_position_limit。这一步非常关键,因为它完成了从连续风险特征到交易执行约束的第一次变换。下游不再需要重新理解波动率和相关性,只需要知道:这只股票现在最多还能加多少仓。

6. 执行函数

[src/agents/portfolio_manager.py]

6.1 为什么这个文件最值得学

如果只能选一个文件来代表整个仓库的工程水准,我会选 portfolio_manager.py。原因很简单:它最清楚地体现了“规则先行,LLM 后决策”的理念。很多项目会把 LLM 放在一切约束之前,而这里恰恰相反——所有该由程序完成的边界计算,都会先做完,然后才把剩余空间交给模型。

这种思路在任何高约束业务里都非常有价值,不只是金融。只要任务里存在大量硬边界、离散动作和安全要求,这种写法几乎总比端到端模型输出更可靠。

6.2 portfolio_management_agent():执行层 orchestrator

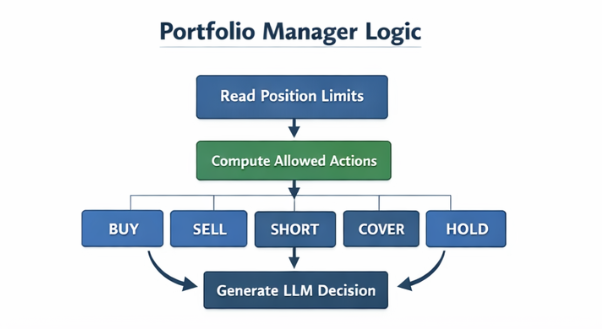

portfolio_management_agent(state, agent_id="portfolio_manager") 自己并不直接做交易推理。它读取 portfolio、analyst_signals 和 tickers,先从 risk manager 的结果里找出每个 ticker 的 remaining_position_limit 和 current_price,再换算成整数股数层面的 max_shares[ticker] = int(position_limit // current_price)。随后,它把所有 analyst 输出按 ticker 聚合成统一结构,然后交给 generate_trading_decision()。

这个函数最值得注意的地方,是它的职责非常纯。它不重新做风控,也不自己决定买卖,只负责把上游结果整理成组合管理层最需要的输入。这正是一个干净的 orchestrator 应该做的事情。

6.3 compute_allowed_actions():执行层最关键的安全边界函数

compute_allowed_actions(tickers, current_prices, max_shares, portfolio) 是整个仓库里最值得抄作业的函数之一。它会根据当前现金、保证金占用、保证金要求、现有 long/short 仓位和风控层给出的 max_shares,为每个 ticker 计算出一个合法动作集合。这个集合通常包含 buy、sell、short、cover、hold,但真正返回时会剪掉所有容量为 0 的动作,只留下可能发生的选项。

它的逻辑非常清楚:sell 的上限等于当前 long 股数,cover 的上限等于当前 short 股数,buy 既受风险股数上限约束,也受现金约束,short 则同时受风控股数和可用保证金约束。也就是说,在模型看到任何动作之前,程序已经把所有交易合法性校验做完了。

6.4 为什么 compute_allowed_actions() 这么重要

这个函数真正重要的地方,不在于写法复杂,而在于它明确了一条原则:LLM 不应该负责理解交易边界。 如果一个动作在当前组合状态下本来就不合法,那它根本不应该出现在模型可选集合里。与其让模型在 prompt 里“记住不要这么做”,不如直接在程序层面把这种动作删掉。

这是一种很成熟的系统设计习惯。凡是约束明确、可程序化验证的东西,都应该尽量前置成规则,而不是留到模型输出之后再做补救。这种思想恰恰是 ai-hedge-fund 比很多 Agent Demo 更像工程项目的原因。

6.5 _compact_signals():不是小工具,而是 prompt 压缩器

_compact_signals(signals_by_ticker) 看上去像个不起眼的小函数,但它实际上承担了非常重要的 token 管理工作。它会把 analyst 输出统一压缩成 {agent: {sig, conf}} 这样的短字段结构,同时兼容 sig/conf 与 signal/confidence 两种命名。这么做不是为了美观,而是为了让传给最终决策模型的上下文尽可能短。

多代理系统很容易在最后一步 prompt 爆炸:ticker 多、agent 多、字段多,一不小心上下文就会变得非常臃肿。_compact_signals() 就是在做一件很现实的事情——尽量把真正有用的信息保留下来,把冗余字段压掉,让 LLM 只看到它真的需要看到的内容。

6.6 generate_trading_decision():最终决策函数的四步法

generate_trading_decision(...) 是执行层最后的核心函数。它一开始先调用 compute_allowed_actions() 得到完整合法动作空间,然后立刻把那些只剩 hold 的 ticker 直接预填为 hold 决策。只有真正还存在选择空间的 ticker,才会被送给 LLM。随后,它再把 analyst 信号和 allowed actions 都压缩成紧凑格式,构造 prompt,并通过 call_llm(..., pydantic_model=PortfolioManagerOutput) 强约束模型输出为结构化 JSON。

更成熟的一点在于,它还准备了默认回退工厂。如果模型调用失败、解析失败、或者返回不符合 schema,系统不会直接崩掉,而是把相应 ticker 回退成 hold。这意味着最终决策过程实际上由四步组成:程序先算动作边界,程序先处理无选择空间的 ticker,模型只处理剩余少量 case,模型失败时系统自动回退。这样的设计非常适合高风险业务。

6.7 执行层的真正启发

把 portfolio_manager.py 看懂以后,你会发现这个仓库最值得学的从来不是某个 analyst 的方法论,而是执行层的这个模式:先把问题缩小到一个安全、离散、结构化的动作空间,再让模型做最后一跳。 这其实是一种非常通用的 Agent 设计套路。

无论你以后做审批流、风控流、策略配置、法务审阅还是运维决策,只要问题里有大量规则边界,这种“先裁空间、再用模型”的思路都比端到端直接生成更稳。这也是为什么我会认为 portfolio_manager.py 是整个仓库最值得反复读的一部分。

7. 回测与部署

[src/backtester.py、src/backtesting/engine.py、app/]

7.1 回测为什么单独成层

如果一个系统只能对单个时间点给出一次结果,那它还很难称得上是交易研究框架。ai-hedge-fund 把回测单独抽成 src/backtester.py 和 src/backtesting/engine.py,说明作者至少意识到了“单次推理”和“沿时间轴反复验证”不是一回事。回测层存在的意义,就是把同一条 agent 决策链拿到历史时间序列里反复运行,并记录组合估值和绩效结果。

这一层对工程质量的要求通常比单次运行更高,因为它会暴露重复 API 请求、数据预取、缓存命中、执行成本和结果持久化等问题。很多看起来能跑的 demo,一旦进入回测就会出现各种现实瓶颈。正因为如此,回测层在这个仓库里不是附属品,而是系统闭环的重要组成部分。

7.2 src/backtester.py:入口壳的职责

src/backtester.py 本身并不复杂,它主要负责解析命令行参数、创建 BacktestEngine、然后调用 run_backtest()。把它理解成一个入口壳就够了。真正值得读的,是 src/backtesting/engine.py 里的主循环和组件初始化。

这种拆法是很合理的,因为入口文件应该尽量轻。它只负责接收外部调用参数,而真正的业务逻辑则放进更明确的 engine 层。这样做的好处是,后面如果你要从 API、任务队列或者别的入口触发回测,都不需要复制回测逻辑本身。

7.3 BacktestEngine.__init__():回测系统的组件化结构

在 BacktestEngine 的初始化阶段,仓库会准备 Portfolio、TradeExecutor、AgentController、OutputBuilder、BenchmarkCalculator 等多个组件。这意味着回测不是“一段 for 循环 + 一堆 if/else”写到底,而是已经具备了基本的组件化结构。Agent 负责出决策,executor 负责执行,估值和基准对比则由其他模块处理。

从工程角度看,这种拆分非常值得鼓励。因为一旦你想替换成交逻辑、增加滑点、增加借券费用、接不同 benchmark,组件化结构会让你更容易改动,而不是被迫去拆一个难以维护的大函数。

7.4 _prefetch_data():回测里的性能意识

回测层里一个很重要的函数是 _prefetch_data()。它会提前预拉价格、财务指标、内幕交易、新闻以及 benchmark 数据,以尽量减少回测主循环中重复请求外部 API 的开销。这是一种非常典型、也非常必要的优化,因为回测一旦按交易日滚动,外部调用次数会指数级增加。

当然,它当前也还不是完美实现。比如价格预取窗口的选择,在长区间回测时就可能不够理想。但这并不是缺点,恰恰说明这个项目已经从“能不能跑”进入了“如何跑得更稳、更快”的工程阶段。对于源码阅读者来说,这种阶段性的真实问题比一个完全没有性能痕迹的 demo 更有学习价值。

7.5 run_backtest():沿时间轴重复同一条决策链

run_backtest() 的核心逻辑其实非常清楚:先预取数据,生成 business day 序列,然后对每一个交易日调用同一条 agent pipeline,拿到决策结果后通过 executor 更新组合,再重新估值并记录指标。换句话说,回测层不是另写一套策略,而是在时间维度上反复调用同一套 analyst → risk → portfolio 决策链。

这点非常重要。因为它意味着研究系统和验证系统没有彻底分裂成两套代码。你在 CLI 下看到的单次决策逻辑,和你在回测里重复运行的逻辑本质上是同一套东西。这样的代码组织方式,更容易让研究结果和验证结果保持一致。

7.6 Web 层与本地部署方式

除了回测,app/ 目录也值得一提。它把整个系统包装成一个 FastAPI 后端加 React/Vite 前端的 Web 应用。官方 README 已经给出了 run.sh / run.bat 一键启动方式,同时也支持前后端分别启动。这种结构意味着你不仅可以从 CLI 观察工作流,还可以从 API 层和 UI 层观察同一条链路。

如果只是本地研究,我更推荐 CLI 或者前后端分开启动,因为这样最便于调试。如果是长期运行,至少要考虑更生产化的启动方式、环境变量管理、反向代理、缓存和结果持久化。也就是说,仓库当前的部署说明已经足够做本地开发,但要走向长期服务化还需要再补一层工程化工作。

7.7 回测与部署层的意义

所以,这一层最重要的启发其实不是“怎么启动一个页面”,而是:一个 Agent 工作流只要开始接触时间轴、API 成本和交互界面,就不再只是一个 notebook 式实验,而会越来越像一个真正的软件系统。ai-hedge-fund 正处在这个转折点上,这也是它比许多纯概念仓库更值得分析的原因。

8. 参考原则

8.1 先关注系统边界,再关注角色叙事

很多人读这个仓库时,会被“Buffett agent”“Burry agent”这些叙事化角色吸引。但如果你想真正学到对自己有用的东西,重点不应该放在这些角色化命名上,而应该放在架构层:状态如何管理,工作流如何组织,风控如何落地,动作空间如何裁剪,模型如何被限制在最后一步。

换句话说,这个项目最值得借鉴的从来不是人物 prompt,而是系统边界设计。只要抓住这一点,你会发现它带来的启发远远超出金融领域本身。

8.2 原则一:用图组织复杂任务

StateGraph 在这个项目里不是“为了追 LangGraph 热点”,而是确实适合这个问题形态。多 analyst 并列分析、统一收敛到风控、再进入组合管理,这种结构天然就是图,而不是链。图式工作流的好处是你可以清楚地表达哪些节点是并行视角,哪些节点是收敛节点,哪些节点必须放在下游。

在任何复杂 Agent 系统里,只要任务不是纯线性的,一开始就用图思维建模,通常都比后面再补救要容易得多。

8.3 原则二:统一状态对象优先于分散传参

AgentState 看起来不起眼,但它实际上决定了整套系统能否持续演进。没有统一状态,多代理系统就会迅速变成一堆函数和变量的拼盘;有了统一状态,你就可以更容易地加缓存、加日志、加 tracing、加前端展示,也更容易定位是谁在修改什么数据。

所以如果你准备自己做类似系统,最先该抄的往往不是某个 agent,而是这种显式状态容器。

8.4 原则三:把硬约束放在模型之外

这是整个仓库最成熟的地方,也是最适合迁移到别的业务里的地方。仓位上限、现金约束、保证金约束、合法动作集合,这些都应该由程序来决定,而不是让模型“理解之后别犯错”。因为一旦规则可程序化验证,就没有理由只把它写在 prompt 里。

这条原则其实适用于所有高约束场景:审批、风控、法律、运维、供应链、医疗辅助决策,都一样。只要你能先把边界写死,就应该先写死,再让模型在剩下的空间里做判断。

8.5 原则四:让模型只处理最后一步高价值判断

portfolio_manager.py 的精华就在这里。它先裁掉不合法动作,再裁掉没有选择空间的 ticker,再压缩 analyst 输出,最后才把极少量、真正需要权衡的 case 交给 LLM。这种顺序不仅节省 token,也显著降低了模型犯错范围。

如果你把这条原则记住,再去看别的 Agent 系统,就会很容易发现哪些项目把模型用在了最不该用的位置,而哪些项目真正理解了模型和规则系统应该如何配合。

8.6 这些原则如何迁移到其他场景

所以,virattt/ai-hedge-fund 最值得学习的,不是它是不是已经接近真实对冲基金,而是它展示了一条非常清楚的工程路线:分析层产出信号,风控层换算仓位边界,执行层裁出合法动作空间,模型在边界内做最后选择,回测层沿时间轴反复验证。这个套路完全可以迁移到许多非金融业务场景。

如果你把它当成“AI 量化项目”来看,收获可能只停留在兴趣层面;但如果你把它当成“高约束 Agent 工作流范例”来看,它就会变成一个很值得反复拆的工程样本。这也是这篇文章最终想强调的地方。

9. 核心源代码解读

9.1 工作流入口:src/main.py 如何把系统真正跑起来

如果要在整个仓库里只挑一个最适合做“主入口走读”的文件,那一定是 src/main.py。因为这个文件并不承担复杂的金融分析逻辑,它真正负责的是把所有模块装进一条可执行链路:读取输入参数、初始化 portfolio、创建 LangGraph 工作流、编译 graph,然后把统一状态送进整个 agent 系统。也正因为它足够“中枢化”,所以最适合作为核心源码解读的起点。

从函数职责来看,run_hedge_fund() 更像是一次完整执行的 orchestration shell。它不会去算技术指标,也不会去做仓位边界推导,而是把 tickers、portfolio、start_date、end_date、analyst_signals、model_name、model_provider 等运行所需信息打包进同一个状态对象。这样一来,无论你是从命令行触发,还是后面从 API 或回测层触发,内部看到的都是同一种状态格式。

这个文件里最值得重点读的其实是 create_workflow()。它通过 StateGraph(AgentState) 搭了一张清晰的执行图:起点节点先发散到多个 analyst 节点,再统一收敛到 risk_management_agent,最后进入 portfolio_manager。这和很多“一个 agent 包办全部事情”的项目完全不同。作者在这里并没有追求让某个大模型变成万能决策器,而是先把复杂任务拆成多个职责明确的阶段,再用图来表达阶段之间的依赖关系。

从工程角度看,main.py 的价值不在“逻辑复杂”,而在“层次清晰”。它告诉你一个复杂 Agent 系统不应该从 prompt 开始设计,而应该从执行链路开始设计:什么是起点,哪些节点是并列分析视角,哪些节点是统一收敛节点,哪些节点必须位于下游。只有先把工作流画出来,后面的状态设计、风控设计和决策设计才不会混成一团。

9.2 信号生产层:analyst 节点如何把原始数据变成统一输出

第二个必须重点看的部分,是 analyst 层的源码组织。因为整个系统是否可扩展,很大程度上取决于它能否把不同风格、不同数据来源、不同分析逻辑的 agent 统一纳入一个输出接口。从当前仓库来看,这一层做得相当规整:agent 注册集中在 src/utils/analysts.py,具体实现分散在 src/agents/*.py,但最后都被收敛成 analyst_signals 这一套共享结构。

以 fundamentals_analyst_agent() 为例,它不是把财务信息直接扔给大模型,而是先通过 get_financial_metrics() 拉指标,再按盈利能力、成长性、财务健康和估值四个维度做判断,最终生成结构化的 signal / confidence / reasoning。换句话说,这个 agent 更接近一个规则驱动的信号生产器,而不是自由发挥的评论员。这样的写法,在金融场景里要比“直接问模型一家公司的基本面怎么样”稳健得多。

sentiment_analyst_agent() 和 technical_analyst_agent() 则展示了另外两种信号生产模式。前者把内幕交易和新闻情绪做轻量融合,后者把趋势、均值回归、动量、波动率和统计套利等子策略做加权组合。三者虽然分析对象不同,但最终都输出为兼容的 analyst signal 结构。也就是说,上游可以有很多不同方法论,但到工作流中间层时,大家都必须说同一种“数据语言”。 这就是 analyst 层能规模化扩展的关键。

如果要从源码层面总结 analyst 层最值得学习的地方,我会用一句话概括:先把原始信息压缩成标准信号,再把标准信号交给下游处理。这样做的好处是显而易见的——风控层不需要重新面对财报和新闻,组合管理层也不需要理解一堆细粒度指标,它们只需要消费统一输出即可。这种“数据收敛”能力,恰恰是大型 Agent 系统最容易缺失的一环。

9.3 风控核心:risk_manager.py 如何把风险特征转成仓位边界

第三个核心部分就是 src/agents/risk_manager.py。如果说 analyst 层负责“产生观点”,那 risk manager 负责的就是“给观点上边界”。从系统设计上讲,这一层的重要性往往被低估,因为它不会直接产出 buy 或 sell,看起来不如最终决策层显眼。但真正决定系统是否像一个交易框架,而不是一个观点集合的,恰恰就是这一层。

risk_management_agent() 的处理顺序很值得细看。它首先不是只看当前待决策的 tickers,而是把当前 portfolio 已有持仓一起纳入计算。然后对每个相关 ticker 拉取价格、计算波动率、保存收益率序列,并在条件允许时进一步构造相关性矩阵。这个顺序说明作者对组合风险有基本清醒认识:单票风险和组合风险不是两件事,必须一起看。

更关键的是,risk manager 输出的不是方向建议,而是 remaining_position_limit。这意味着它真正完成的是一次约束变换:把连续的市场风险特征(波动率、相关性、当前持仓暴露)换算成一个下游可以直接消费的仓位上限。从 calculate_volatility_metrics() 到 calculate_volatility_adjusted_limit(),再到 calculate_correlation_multiplier(),整套函数链条都在做这件事。

9.3.1 函数调用链:风控节点内部是怎么串起来的

如果把 risk_management_agent() 的执行过程按函数调用链压缩,可以得到下面这条主线:

risk_management_agent(state)

├─ get_api_key_from_state(state)

├─ 读取 portfolio / tickers / start_date / end_date

├─ all_tickers = tickers ∪ current_positions

├─ 对每个 ticker:

│ ├─ get_prices(ticker, start_date, end_date)

│ ├─ prices_to_df(prices)

│ ├─ calculate_volatility_metrics(prices_df)

│ └─ 保存 current_prices / returns_by_ticker / vol_data

├─ 若收益率样本足够:

│ └─ correlation_matrix = returns_df.corr()

├─ 计算 total_portfolio_value

├─ 对每个 ticker:

│ ├─ calculate_volatility_adjusted_limit(annualized_volatility)

│ ├─ calculate_correlation_multiplier(avg_correlation)

│ ├─ 计算 combined_limit_pct

│ ├─ 计算 position_limit

│ └─ 计算 remaining_position_limit

└─ 写回 analyst_signals[risk_management_agent]

这条调用链里最关键的不是函数数量,而是顺序关系。你会发现 risk manager 并没有一上来就给仓位比例,而是先把所有必要的市场特征补齐:价格、收益率、波动率、相关性、当前持仓暴露、组合总值。只有这些中间变量都准备好之后,仓位边界才有意义。

9.3.2 伪代码框图:从市场特征到仓位边界

如果进一步把这条函数调用链翻译成伪代码,可以更清楚地看到风控节点在做什么:

def risk_management_agent(state):

portfolio = state["data"]["portfolio"]

tickers = state["data"]["tickers"]

start_date = state["data"]["start_date"]

end_date = state["data"]["end_date"]

all_tickers = union(tickers, portfolio.positions.keys())

current_prices = {}

volatility_data = {}

returns_by_ticker = {}

for ticker in all_tickers:

prices = get_prices(ticker, start_date, end_date)

prices_df = prices_to_df(prices)

vol_metrics = calculate_volatility_metrics(prices_df)

volatility_data[ticker] = vol_metrics

current_prices[ticker] = latest_close(prices_df)

returns_by_ticker[ticker] = pct_change(prices_df.close)

correlation_matrix = maybe_build_correlation_matrix(returns_by_ticker)

total_portfolio_value = cash + long_market_value - short_market_value

for ticker in tickers:

annualized_vol = volatility_data[ticker]["annualized_volatility"]

vol_limit_pct = calculate_volatility_adjusted_limit(annualized_vol)

avg_corr = average_correlation_with_active_positions(ticker, correlation_matrix)

corr_multiplier = calculate_correlation_multiplier(avg_corr)

combined_limit_pct = vol_limit_pct * corr_multiplier

position_limit = total_portfolio_value * combined_limit_pct

current_position_value = abs(long_value - short_value)

remaining_position_limit = max(0, position_limit - current_position_value)

save_risk_output(

ticker=ticker,

current_price=current_prices[ticker],

remaining_position_limit=remaining_position_limit,

volatility_metrics=volatility_data[ticker],

correlation_metrics={"avg_corr": avg_corr},

)

这个伪代码最值得注意的地方,是它把风控层的角色讲得非常明确:不决定方向,只决定上限。 换句话说,risk manager 不会回答“该不该买”,它只回答“如果要买,现在最多能买到什么程度”。在系统分层上,这是一种非常健康的职责边界。

9.3.3 三个关键函数分别解决什么问题

为了把风控节点读透,最好把其中三个关键辅助函数分开理解。

第一,calculate_volatility_metrics() 负责把价格序列压缩成风险度量,包括日波动率、年化波动率和历史分位位置。它解决的是“这只资产最近到底有多波动”这个问题。

第二,calculate_volatility_adjusted_limit() 负责把年化波动率映射成基础仓位比例。它解决的是“在单票风险层面,这只资产最多应该占组合多大权重”。

第三,calculate_correlation_multiplier() 负责根据平均相关性再乘一个调整系数。它解决的是“这只资产虽然单独看不一定很危险,但如果和现有持仓过于相似,是否还应该进一步压仓”。

这三个函数串起来以后,风险约束就不再是一个黑箱结果,而是能被解释成:单票风险预算 × 组合拥挤度调整。

9.3.4 为什么这一层对下游如此重要

从工作流角度看,risk manager 的价值不只是帮系统做得更保守,而是让下游彻底从“理解风险特征”这件事里解放出来。portfolio_manager.py 不需要重新面对波动率时间序列,也不需要重新算相关性矩阵,它只需要消费一个已经被压缩好的结果:remaining_position_limit。

这是一种非常典型的中间层设计哲学:上游负责把复杂连续特征压缩成简单可传递变量,下游只消费压缩后的边界。复杂度一旦在中间层被成功吸收,后面的执行层就会自然变得更稳、更短、更容易验证。

9.4 决策核心:portfolio_manager.py 如何把边界裁成合法动作空间

第四个核心部分是 src/agents/portfolio_manager.py,也是全仓库最有“系统设计味”的一段代码。原因很简单:它体现了一个非常成熟的原则——模型只处理最后一步判断,规则系统先把问题空间缩小。 如果没有这个文件,整个项目依然可能只是“很多 agent 说了一堆观点”;有了它,系统才真正具备“在合法动作空间里做选择”的能力。

portfolio_management_agent() 自己并不直接做推理,它更像一个执行层 orchestrator。它先从 risk manager 的结果里读取 remaining_position_limit 和 current_price,把它们转换成整数股数层面的 max_shares,再把所有 analyst 输出整理成 signals_by_ticker。这个步骤非常关键,因为它把“风险约束”和“分析结论”压缩成了最终决策所需的最小输入集。

真正的关键函数是 compute_allowed_actions() 和 generate_trading_decision()。前者根据现金、保证金、持仓和 max_shares 为每个 ticker 计算出合法动作空间;后者则先把只有 hold 这一种选择的 ticker 直接预填为 hold,再把剩余 ticker 的 Signals 和 Allowed 送给 LLM,并用 Pydantic schema 强约束返回格式。模型失败时还会默认回退到 hold。这一整套处理流程体现出的不是“让模型聪明”,而是“让系统更稳”。

如果要给这个文件下一个最精炼的判断,我会说它完成了第二次关键约束变换:risk manager 把风险特征转成仓位边界,而 portfolio manager 再把仓位边界转成离散的合法动作集合。最后模型看到的世界,已经不再是原始市场,而是一个被规则系统高度裁剪过的安全决策空间。这种设计几乎是所有高约束 Agent 系统都值得借鉴的模板。

9.4.1 函数调用链:执行层内部的真实顺序

如果把 portfolio_management_agent() 的内部流程按函数调用链写出来,会更容易理解它到底做了哪些前置收缩:

portfolio_management_agent(state)

├─ 读取 portfolio / analyst_signals / tickers

├─ 找到 risk_management_agent 对应输出

├─ 对每个 ticker:

│ ├─ 读取 remaining_position_limit

│ ├─ 读取 current_price

│ └─ 计算 max_shares = int(limit // price)

├─ 整理所有 analyst 输出为 signals_by_ticker

└─ generate_trading_decision(...)

├─ compute_allowed_actions(...)

├─ 对只剩 hold 的 ticker 直接预填 hold

├─ _compact_signals(...)

├─ 构造 compact_allowed

├─ call_llm(..., pydantic_model=PortfolioManagerOutput)

└─ merge(prefilled_decisions, llm_decisions)

这条链路里最重要的不是“调用了模型”,而是模型调用其实已经排在很后面。也就是说,执行层的大部分工作都发生在调用 LLM 之前:读取风控上限、转换为股数、按 ticker 聚合 analyst 信号、裁出合法动作、剔除无选择空间的 ticker、压缩上下文。模型真正看到的,只是最后剩下的一小块问题空间。

9.4.2 伪代码框图:从仓位边界到最终交易动作

把这一层再翻译成伪代码,会更清楚地看到执行层是如何逐层缩小问题规模的:

def portfolio_management_agent(state):

portfolio = state["data"]["portfolio"]

tickers = state["data"]["tickers"]

analyst_signals = state["data"]["analyst_signals"]

risk_output = analyst_signals["risk_management_agent"]

max_shares = {}

current_prices = {}

for ticker in tickers:

limit = risk_output[ticker]["remaining_position_limit"]

price = risk_output[ticker]["current_price"]

current_prices[ticker] = price

max_shares[ticker] = int(limit // price) if price > 0 else 0

signals_by_ticker = group_signals_from_all_analysts(analyst_signals, tickers)

decisions = generate_trading_decision(

tickers=tickers,

signals_by_ticker=signals_by_ticker,

current_prices=current_prices,

max_shares=max_shares,

portfolio=portfolio,

state=state,

)

return decisions

而 generate_trading_decision() 的核心又可以单独画成一层:

def generate_trading_decision(...):

allowed_actions = compute_allowed_actions(tickers, current_prices, max_shares, portfolio)

prefilled_decisions = {}

tickers_for_llm = []

for ticker in tickers:

if only_hold_is_allowed(allowed_actions[ticker]):

prefilled_decisions[ticker] = hold_decision()

else:

tickers_for_llm.append(ticker)

if not tickers_for_llm:

return prefilled_decisions

compact_signals = _compact_signals(filter_by_tickers(signals_by_ticker, tickers_for_llm))

compact_allowed = filter_by_tickers(allowed_actions, tickers_for_llm)

llm_output = call_llm(prompt=build_prompt(compact_signals, compact_allowed),

pydantic_model=PortfolioManagerOutput,

default_factory=create_default_hold_output,

)

return merge(prefilled_decisions, llm_output.decisions)

这个伪代码框图最清楚地说明了一件事:执行层不是让模型从 0 到 1 生成交易,而是让程序先把 90% 的问题裁掉,再让模型只处理最后 10% 的选择。

9.4.3 compute_allowed_actions() 是真正的边界生成器

从函数重要性来看,compute_allowed_actions() 其实比最终的 call_llm() 更值得认真看。因为它负责把连续型限制真正转成离散型动作空间。现金约束决定 buy 最多能买多少股,已有 long 仓位决定 sell 最多能卖多少股,已有 short 仓位决定 cover 最多能回补多少股,保证金约束和风控股数上限一起决定 short 最多能开到什么程度。

函数执行完之后,模型不再面对“无限可能”的动作集,而只会看到像这样一类结果:某只股票现在只能 hold,另一只股票可以 buy 最多 120 股或 hold,还有一只股票可以 sell 现有 40 股或 hold。这和直接让模型从自由文本里生成“买多少、卖多少”完全不是一个问题复杂度。

9.4.4 _compact_signals() 和 prompt 压缩为什么不能忽略

执行层里还有一个容易被低估的细节,就是 _compact_signals()。它的工作看上去只是把 analyst 输出字段缩短成 sig 和 conf,但实际上它承担的是 prompt 压缩职责。多代理系统一旦 analyst 数量多、ticker 数量多,最终上下文就会急剧膨胀。如果不在模型调用前做这种结构压缩,系统会越来越慢、越来越贵,也越来越不稳定。

所以 _compact_signals() 虽然只是个小函数,但它代表了一个很现实的工程意识:模型上下文也是资源,必须在进入模型前做裁剪。 这类看似“不核心”的细节,往往恰恰决定了一个系统在真实运行时是否还能保持可控。

9.4.5 为什么这一层是整个仓库最值得借鉴的设计

把 portfolio_manager.py 看透以后,你会发现它真正优秀的地方从来不是 prompt 本身,而是它组织 prompt 之前做的所有事。它先消费 risk manager 产出的上限,再将上限换算成 max_shares,然后把这些上限进一步转成合法动作空间,再把没有选择空间的 ticker 剔除掉,最后才让模型进入。

换句话说,portfolio_manager.py 的本质不是“让模型帮你做交易”,而是“让规则系统先把交易问题变成一个安全、有限、结构化的选择题,然后让模型做最后的权衡”。这种模式完全可以迁移到别的高约束业务里,而不仅仅是交易系统。

9.5 时间轴与产品壳:回测引擎和 Web 接口如何把系统闭环

最后一个核心部分,必须放在回测和 Web 这两个外围层。因为只讲 analyst、risk manager 和 portfolio manager,还只能说明“系统内部逻辑是怎么转的”;而一旦进入 src/backtesting/engine.py 和 app/*,你看到的就是它如何从内部逻辑变成一个真正可运行、可验证、可交互的系统。

BacktestEngine 的价值在于,它并没有另写一套独立策略,而是把同一条 agent 决策链放到 business day 序列里反复执行。_prefetch_data() 先做数据预热,run_backtest() 再按交易日循环调用决策链、执行业务动作、重新估值组合并记录指标。这说明回测层不是仓库里的附属品,而是整套设计闭环的一部分:没有回测,你只能看到某一天的观点;有了回测,你才能观察整条决策链在时间轴上的行为。

与此同时,app/backend 和 app/frontend 的存在又让这套工作流从“研究代码”进一步走向“工具形态”。FastAPI 提供统一的 HTTP 入口,React/Vite 前端则提供交互壳。这并不意味着前端比核心算法更重要,而是说明作者已经意识到:一个真正可用的 Agent 系统,不只是能在终端里跑通,还必须能被 API 和界面自然包装起来。也正是因为有了回测和 Web 这两层,ai-hedge-fund 才不像一个零散 demo,而更像一套逐渐成形的软件系统。

9.5.1 函数调用链:BacktestEngine 是如何驱动整条决策链的

如果把 BacktestEngine 的执行过程抽象成函数调用链,可以得到下面这条主线:

src/backtester.py

├─ 解析 CLI 参数

├─ 创建 BacktestEngine(...)

└─ run_backtest()

├─ _prefetch_data()

│ ├─ 预取 prices

│ ├─ 预取 financial metrics

│ ├─ 预取 insider trades

│ ├─ 预取 company news

│ └─ 预取 benchmark prices

├─ 生成 business day 序列

├─ 对每个交易日:

│ ├─ AgentController 运行 agent graph

│ ├─ PortfolioManagerOutput -> TradeExecutor

│ ├─ 更新 portfolio

│ ├─ 估值组合价值

│ ├─ 记录 exposure / metrics / benchmark

│ └─ 追加 results timeline

└─ OutputBuilder 汇总输出

这条调用链说明了一件很重要的事:回测层不是写死一个策略公式,然后在历史数据上滚动回放;它真正做的是把“单次决策系统”包装成一个沿时间轴重复执行的控制器。也就是说,BacktestEngine 的意义不在于发明了新的交易逻辑,而在于把 analyst → risk → portfolio 这条内部工作流稳定地放到历史序列中复现。

9.5.2 伪代码框图:回测主循环到底在做什么

如果把 run_backtest() 的核心逻辑翻译成伪代码,它大致可以被理解为下面这个结构:

def run_backtest():

_prefetch_data()

dates = business_day_range(start_date, end_date)

portfolio_values = []

benchmark_values = []

trade_log = []

for current_date in dates:

lookback_start = compute_lookback_window(current_date)

current_prices = get_daily_prices(tickers, current_date)

agent_output = agent_controller.run(

tickers=tickers,

start_date=lookback_start,

end_date=current_date,

portfolio=current_portfolio_snapshot(),)

decisions = extract_decisions(agent_output)

for ticker, decision in decisions.items():

trade_executor.execute(

ticker=ticker,

action=decision.action,

quantity=decision.quantity,

price=current_prices[ticker],

portfolio=portfolio,

)

trade_log.append(record_trade(...))

total_value = portfolio.calculate_total_value(current_prices)

exposures = portfolio.calculate_exposures(current_prices)

benchmark_value = benchmark_calculator.update(current_date)

portfolio_values.append(total_value)

benchmark_values.append(benchmark_value)

save_daily_snapshot(current_date, total_value, exposures, decisions)

return output_builder.build(

portfolio_values=portfolio_values,

benchmark_values=benchmark_values,

trades=trade_log,

)

这个伪代码最值得注意的地方,是它明确展示了回测层和单次运行之间的关系:回测并不是另一套算法,而是把同一套 agent 决策逻辑嵌进一个按交易日推进的大循环中。 换句话说,回测层的职责是控制时间,而不是替代决策链本身。

9.5.3 _prefetch_data():为什么它是回测里最先要看的函数

如果你真正打算读 BacktestEngine,第一个该精读的函数其实不是 run_backtest(),而是 _prefetch_data()。原因很简单:只要进入回测,多天、多 ticker、多 analyst 的调用组合会迅速放大外部 API 请求量。价格、财务指标、新闻、内幕交易、benchmark 数据,如果不提前做预取和缓存,回测很快就会变得既慢又贵。

因此,_prefetch_data() 的存在其实代表了回测层最重要的一种工程意识:不要在主循环里反复做昂贵的外部读取,能提前拉的尽量提前拉,能缓存的尽量缓存。 对技术博客读者来说,这一点很值得强调,因为很多项目在“单次推理”阶段看不出问题,一旦进入回测就会因为缺少数据预热机制而性能崩溃。

从系统分层上讲,_prefetch_data() 并不产生任何策略信息,但它决定了整条回测链能否稳定运行。也就是说,回测系统里真正关键的代码,并不总是最像“策略”的代码,有时候反而是这种看上去像基础设施的函数。

9.5.4 run_backtest():如何把单次决策转换成时间序列实验

run_backtest() 的核心价值,在于它完成了一次与前两层不同的“约束变换”。前面的 risk manager 和 portfolio manager,分别把市场风险特征压缩成仓位边界,再把仓位边界压缩成离散动作空间;而 run_backtest() 则把“单个时点的一次决策”压缩进“一个时间序列实验框架”。

这意味着它必须做三件事:第一,定义时间推进方式,也就是 business day 序列;第二,在每一天上重建一个足够真实的局部上下文,包括当前日期、回看窗口、当前组合状态;第三,把执行后的结果沉淀成可比较的时间序列输出,例如组合净值、基准表现、交易日志、风险暴露等。只有这样,系统才不再只是一个会说话的 Agent,而是一个能够被验证的实验对象。

从工程角度看,这一步的重要性经常被低估。因为很多 AI 项目只要能“给出答案”就算完成,而真正的研究系统则必须能解释:如果你连续这么做很多天,结果会发生什么。回测主循环正是为此而存在。

9.5.5 Web 接口层:为什么说它是“产品壳”而不是“算法核心”

与 BacktestEngine 相对应的,是 app/backend 和 app/frontend 这套 Web 层。它们不负责产生策略逻辑,但负责把策略逻辑变成一个可访问、可演示、可交互的系统。后端的价值在于提供统一 API,将运行参数、模型选择、ticker 输入和执行结果封装成 HTTP 协议;前端的价值则在于给这条工作流提供一个对用户友好的操作界面。

把这层理解成“产品壳”很重要。因为它提醒我们:系统的核心智能并不在前端,也不在路由函数里,而是在前面已经拆过的 analyst → risk → portfolio → backtest 这条主链路里。Web 层只是把这条主链路暴露出来,让它更容易被调用、被展示、被复现。对技术博客来说,这样的定位更准确,也能避免把接口层和算法核心混为一谈。

9.5.6 为什么 9.5 让整套系统真正闭环

如果只看前面的 9.1 到 9.4,你会觉得这个仓库已经把内部决策链设计得很完整了。但真正让它从“内部流程”变成“完整系统”的,恰恰是 9.5 这一层。BacktestEngine 负责让决策链沿时间轴复现,Web 层负责让决策链被外部自然调用,这两者分别补齐了“验证闭环”和“交互闭环”。

也正因为如此,ai-hedge-fund 才不只是一个零散的 Agent Demo,而更像一个正在成形的软件系统。对于读者来说,这一节最重要的启发是:一个复杂 Agent 项目真正成熟的标志,不只是内部工作流写通了,而是这条工作流已经能够被时间维度验证、被 API 封装、被界面承载。

10. 项目总结

10.1 总评

virattt/ai-hedge-fund 更适合被定义为一个 多代理决策框架原型,而不是量化交易成品。它的核心价值不在收益表现,而在于把 analyst、risk manager、portfolio manager 和 backtester 放进了同一条可执行链路里,并且让每一层都有明确输入、输出和职责边界。

从源码质量看,这个仓库最值得关注的是“约束如何下沉”。分析层输出标准化信号,风控层输出 remaining_position_limit,执行层输出合法动作集合,最终模型只处理被裁剪后的决策空间。这个分层方式比很多直接让 LLM 生成交易建议的项目更像工程系统。

10.2 优点

这个项目最强的部分不是某个 analyst 的策略逻辑,而是整体控制流。StateGraph 让多代理工作流具备明确的拓扑结构,AgentState 让共享状态有统一容器,ANALYST_CONFIG 让代理注册和前后端配置保持一致,portfolio_manager.py 则把模型调用放在所有硬约束之后。这几个点组合在一起,决定了系统的可维护性。

另一个优点是它把“研究”和“验证”分开了。src/main.py 负责单次运行,src/backtesting/engine.py 负责时间轴回放,app/backend 和 app/frontend 负责把核心链路包装成可交互接口。这种拆分虽然不复杂,但已经具备一个研究型软件系统应有的基本形态。

10.3 局限

这个仓库当前仍然停留在研究原型阶段。首先,它对外部金融数据和模型服务依赖较重,稳定性、成本和可重复性都受上游接口影响。其次,很多 analyst 逻辑仍然是启发式规则,风控模块也更接近可解释的工程近似,而不是机构级风险模型。再次,回测层虽然已经形成闭环,但数据预取、缓存命中、执行成本建模和结果持久化都还有继续补强的空间。

从系统角度看,它还缺少几个生产环境常见要素:更严格的实验追踪、版本化的数据与模型配置、更细的失败恢复策略、以及更完整的执行假设建模。这些缺口并不影响它作为学习样本的价值,但决定了它暂时不适合作为可直接部署的交易平台来理解。